Un plan pentru AI: Ascultă cineva?

Un cadru pentru dezvoltarea responsabilă a inteligenței artificiale

O coaliție bipartizană a creat un cadru pentru dezvoltarea responsabilă a AI, subliniind importanța menținerii oamenilor la conducere și responsabilizarea companiilor AI.

Puncte Cheie

- Pro-Human Declaration oferă un cadru pentru dezvoltarea AI

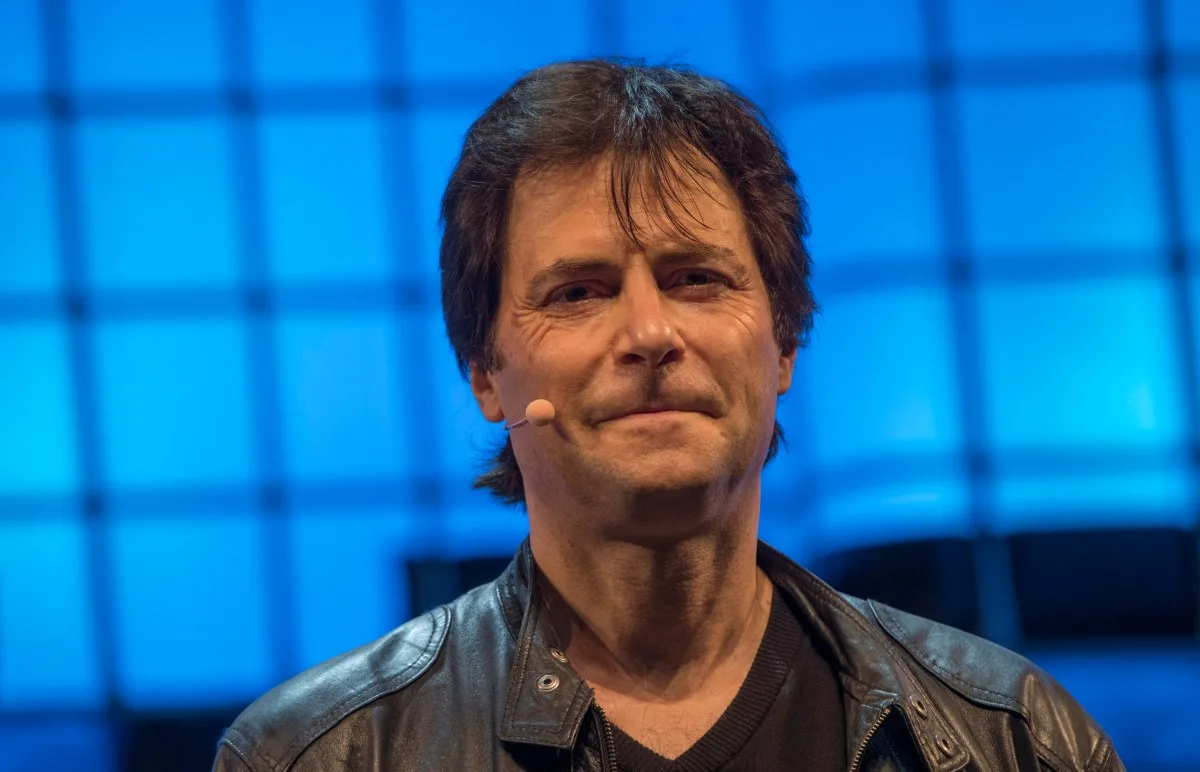

- Max Tegmark, fizician MIT, subliniază opoziția față de o cursă nereglementată către superinteligență

- Documentul este semnat de sute de experți și personalități publice

- Cinci piloni cheie pentru dezvoltarea AI responsabilă

- Pentagonul a etichetat Anthropic drept un „risc de lanț de aprovizionare”

- Apel la testarea pre-deployment a produselor AI pentru siguranța copiilor

- Personalități politice diverse susțin declarația

O Declarație pentru Dezvoltarea Responsabilă a AI

Într-un moment în care Washingtonul și Anthropic și-au întrerupt colaborarea, expunând lipsa totală de reguli coerente pentru guvernarea inteligenței artificiale, o coaliție bipartizană de gânditori a creat ceea ce guvernul nu a reușit să producă până acum: un cadru pentru cum ar trebui să arate dezvoltarea responsabilă a AI. Pro-Human Declaration, finalizată înainte de confruntarea dintre Pentagon și Anthropic, subliniază importanța acestui moment.

Max Tegmark, fizician și cercetător AI la MIT, a declarat: «S-a întâmplat ceva remarcabil în America doar în ultimele patru luni. Sondajele arată brusc că 95% dintre americani se opun unei curse nereglementate către superinteligență.» Documentul, semnat de sute de experți, foști oficiali și figuri publice, începe cu observația că umanitatea se află la o răscruce de drumuri.

Pilonii Dezvoltării AI

Documentul propune două căi: una care duce la înlocuirea oamenilor ca lucrători și decidenți, iar cealaltă care extinde masiv potențialul uman. Scenariul pozitiv depinde de cinci piloni: menținerea oamenilor la conducere, evitarea concentrării puterii, protejarea experienței umane, păstrarea libertății individuale și responsabilizarea legală a companiilor AI. Printre prevederile sale se numără interzicerea dezvoltării superinteligenței până la un consens științific și democratic, întrerupătoare obligatorii pentru sisteme puternice și interdicția arhitecturilor capabile de auto-replicare sau auto-îmbunătățire.

Tensiuni și Acțiuni Guvernamentale

Declarația a fost lansată într-un moment de tensiune. Secretarul Apărării, Pete Hegseth, a desemnat Anthropic drept un „risc de lanț de aprovizionare” după ce compania a refuzat să ofere Pentagonului acces nelimitat la tehnologia sa. În aceeași zi, OpenAI a încheiat un acord cu Departamentul Apărării, pe care experții juridici îl consideră dificil de aplicat. Această situație a evidențiat costurile inacțiunii Congresului în domeniul AI.

Dean Ball, senior fellow la Foundation for American Innovation, a declarat: «Aceasta nu este doar o dispută contractuală. Este prima discuție națională despre controlul sistemelor AI.» Tegmark a oferit o analogie: «Nu trebuie să vă faceți griji că o companie farmaceutică va lansa un medicament care provoacă daune masive înainte ca acesta să fie sigur, pentru că FDA nu va permite lansarea până nu este suficient de sigur.»

Siguranța Copiilor și Viitorul AI

Tegmark vede siguranța copiilor ca punctul de presiune care ar putea sparge impasul actual. Declarația solicită testarea obligatorie înainte de lansare a produselor AI, în special a chatboturilor și aplicațiilor destinate tinerilor, pentru a evalua riscurile precum creșterea ideilor suicidare și manipularea emoțională. «Dacă un bărbat în vârstă trimite mesaje unui copil de 11 ani, pretinzând că este o fată tânără și încearcă să-l convingă să se sinucidă, poate fi închis. Avem deja legi. Este ilegal. De ce ar fi diferit dacă o mașină o face?»

Odată stabilit principiul testării pre-lansare pentru produsele destinate copiilor, Tegmark crede că sfera se va extinde inevitabil. «Oamenii vor veni și vor spune: să adăugăm câteva cerințe. Poate ar trebui să testăm și să ne asigurăm că superinteligența nu are capacitatea de a răsturna guvernul SUA.»

Un Acord Bipartizan

Este semnificativ faptul că foști consilieri politici diverși, precum Steve Bannon și Susan Rice, au semnat același document, alături de foști lideri militari și lideri religioși progresiști. «Ceea ce au în comun, desigur, este că sunt toți oameni», spune Tegmark. «Dacă va trebui să alegem între un viitor pentru oameni sau un viitor pentru mașini, desigur că vor fi de aceeași parte.»

Abonează-te la StiriX

Primește cele mai noi știri tech direct pe email.