Gestionarea memoriei: cheia succesului în modelele AI

Costurile memoriei DRAM au crescut de 7 ori în ultimul an

Costurile pentru cipurile DRAM au crescut de 7 ori în ultimul an, iar gestionarea memoriei devine esențială pentru succesul în AI.

Puncte Cheie

- Costurile pentru cipurile DRAM au crescut de aproximativ 7 ori în ultimul an.

- Orchestrarea memoriei devine crucială pentru eficiența modelelor AI.

- Val Bercovici, director AI la Weka, discută despre complexitatea gestionării memoriei.

- Anthropic a dezvoltat documentații complexe pentru caching-ul prompturilor.

- Start-up-ul TensorMesh lucrează la optimizarea cache-ului pentru AI.

Creșterea costurilor memoriei în infrastructura AI

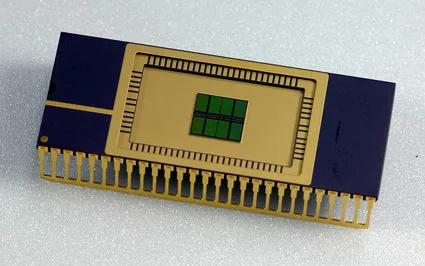

În discuțiile despre costurile infrastructurii AI, accentul cade adesea pe Nvidia și GPU-uri. Totuși, memoria devine o componentă tot mai importantă. Pe măsură ce marii jucători din industrie se pregătesc să construiască centre de date de miliarde de dolari, prețul pentru cipurile DRAM a crescut de aproximativ 7 ori în ultimul an.

Această creștere a prețurilor vine în contextul unei discipline tot mai stricte în orchestrarea memoriei, asigurându-se că datele ajung la agentul potrivit la momentul potrivit. Companiile care reușesc să stăpânească această orchestrare vor putea efectua aceleași interogări cu mai puțini tokeni, ceea ce poate face diferența între succes și eșec în afaceri.

Importanța orchestrării memoriei

Analistul de semiconductori Dan O'Laughlin a discutat despre importanța cipurilor de memorie cu Val Bercovici, director AI la Weka, pe platforma sa Substack. Ambii sunt experți în semiconductori, astfel că discuția s-a concentrat mai mult pe cipuri decât pe arhitectura generală. Totuși, implicațiile pentru software-ul AI sunt semnificative.

Bercovici a subliniat complexitatea tot mai mare a documentației pentru caching-ul prompturilor de la Anthropic. «Dacă ne uităm la pagina de prețuri pentru caching-ul prompturilor de la Anthropic, aceasta a început ca o pagină foarte simplă acum șase sau șapte luni, mai ales când Claude Code a fost lansat — doar 'folosește caching-ul, e mai ieftin.' Acum este o enciclopedie de sfaturi despre câte scrieri de cache să pre-cumperi», a explicat Bercovici.

Provocările și oportunitățile gestionării memoriei

Întrebarea principală este cât timp Claude păstrează promptul în memoria cache: poți plăti pentru o fereastră de 5 minute sau mai mult pentru una de o oră. Este mult mai ieftin să utilizezi date care sunt încă în cache, astfel că, dacă gestionezi corect, poți economisi semnificativ. Totuși, există un dezavantaj: fiecare nouă informație adăugată la interogare poate elimina altceva din fereastra de cache.

Gestionarea memoriei în modelele AI va deveni o componentă esențială în viitorul AI. Companiile care reușesc să o facă bine vor ajunge în top. Există multe progrese de făcut în acest domeniu nou. De exemplu, în octombrie, am acoperit un start-up numit TensorMesh care lucra la un strat din stiva cunoscută sub numele de optimizarea cache-ului.

Progrese în utilizarea memoriei în centrele de date

Există oportunități în alte părți ale stivei. De exemplu, mai jos în stivă, există întrebarea cum centrele de date folosesc diferitele tipuri de memorie pe care le au. (Interviul include o discuție interesantă despre când sunt folosite cipurile DRAM în loc de HBM, deși este destul de tehnică.) Mai sus în stivă, utilizatorii finali își dau seama cum să-și structureze roiurile de modele pentru a profita de cache-ul partajat.

Pe măsură ce companiile devin mai bune la orchestrarea memoriei, vor folosi mai puțini tokeni și inferența va deveni mai ieftină. Între timp, modelele devin mai eficiente la procesarea fiecărui token, reducând și mai mult costurile. Pe măsură ce costurile serverelor scad, multe aplicații care nu par viabile acum vor începe să devină profitabile.

Abonează-te la StiriX

Primește cele mai noi știri tech direct pe email.